I generatori di immagini AI hanno suscitato molto interesse recentemente, ma potrebbero essere difficili da capire. Ecco tutto quello che devi sapere

Con l’intelligenza artificiale generativa che nel 2022 ha di fatto aperto le porte a numerosi scenari incredibili, dopo la generazione di testo ora la nuova frontiera è la generazione di testo in immagini e in video. In questo articolo andremo a vedere come funziona un generatore di immagini AI.

Il primo a scatenare la grande ondata è stato Dall-E 2, seguito poco dopo da Stable Diffusion. Da allora, abbiamo visto arrivare anche altri strumenti, tra cui Midjourney, Craiyon e persino TikTok in una certa misura. Ci sono crescenti preoccupazioni quando si tratta di strumenti di generazione di immagini basati sull’intelligenza artificiale, riguardanti principalmente l’etica di tali strumenti quando possono generare immagini di persone reali in luoghi o situazioni in cui non si trovavano effettivamente.

Tuttavia, non c’è nemmeno solo l’etica da considerare. I generatori di immagini AI sono addestrati su milioni e milioni di foto e hanno imparato a identificare le cose tramite foto esistenti create da persone reali. Quando diventa una violazione del copyright?

Se la tua intelligenza artificiale genera accidentalmente un’immagine che sembra molto simile a un altro disegno e il creatore di quell’immagine la condivide commercialmente, qualcuno è responsabile per eventuali danni? Se sì, chi? Chi è l'”artista” in questo caso?

Ci sono moltissime ragioni per diffidare dei generatori di immagini AI, e queste preoccupazioni etiche e di sicurezza stanno solo scalfendo la superficie. Questi strumenti possono essere utilizzati per creare immagini false che possono essere utilizzate per promuovere qualcosa di reale.

I migliori generatori di immagini AI

Date già le incredibili capacità di questi strumenti di generazione di immagini, è spaventoso pensare cosa saranno in grado di fare molto presto. Tuttavia, se vuoi creare belle immagini e divertirti, non c’è assolutamente nulla di male su questo utilizzo. Ecco i migliori strumenti a disposizione.

Stable Diffusion

Stable Diffusion è l’ispirazione dietro questo articolo e uno strumento con cui ho giocato molto di recente. Funziona localmente sul tuo computer (quindi non devi lottare per le risorse con altri utenti di qualche strumento online) ed è uno dei più potenti che puoi attualmente utilizzare.

Non solo ti consente di mettere a punto moltissimi parametri, ma puoi anche controllare l’intero processo di generazione. Stable Diffusion soffre delle stesse insidie dell’IA, con l’ulteriore “pericolo” dell’accessibilità anche se devi avere un PC abbastanza potente per generare immagini in qualche decina di minuti.

La cosa migliore di Stable Diffusion è che è interamente open source. Puoi implementarne il supporto in qualsiasi tuo progetto oggi, se lo desideri, e ci sono già plugin come Alpaca che puoi utilizzare per integrarlo con Photoshop.

Non è ancora perfetto, ma è ancora molto presto nello sviluppo di questi programmi. Puoi utilizzare Dream Studio se lo desideri, anche se costa denaro ed è un po’ restrittivo rispetto alla configurazione locale. Inoltre, se imposti Stable Diffusion localmente, ci sono fork come Stable Diffusion WebUI di AUTOMATIC1111 che vengono forniti con uno strumento di alto livello integrato che può aumentare la risoluzione fino a quattro volte.

Sebbene sia possibile generare immagini a risoluzioni più elevate, spesso è molto più rapido generare un’immagine a una risoluzione inferiore e quindi migliorarla. Il training Stable Diffusion è stato effettuato su un cluster di 4.000 GPU Nvidia A100 in esecuzione su AWS e si è svolto nell’arco di un mese.

Ha la capacità di generare immagini di celebrità e ha anche un filtro NSFW integrato. Puoi disabilitare questo filtro NSFW sulle installazioni locali, poiché consente di risparmiare risorse diminuendo l’utilizzo della VRAM che è sempre elevato.

Per quanto riguarda il significato di “Diffusione”, è il processo che inizia con il rumore puro e si perfeziona nel tempo. Rende l’immagine sempre più vicina al dettagli di testo nel tempo fino a quando non rimane più alcun rumore. Questo è lo stesso modo in cui funziona Dall-E 2.

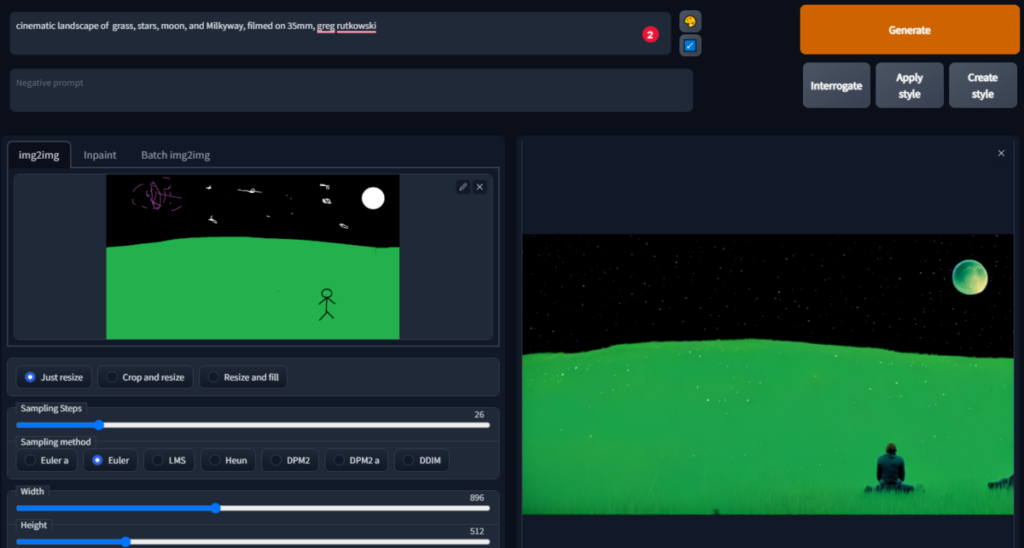

Infine, un’altra caratteristica divertente di Stable Diffusion è “img2img”. In questo, gli dai un’immagine come prompt, descrivi cosa vuoi che sia l’immagine e poi lasci che ti dia un disegno adeguato lasciando all’intelligenza la generazione completa.

In breve, Stable Diffusion è gratuito, facile da configurare e il problema più grande è quanto sia accessibile. Se non disponi di un PC abbastanza potente, dovrai pagare per utilizzarlo tramite Dream Studio che è un impedimento solo economico.

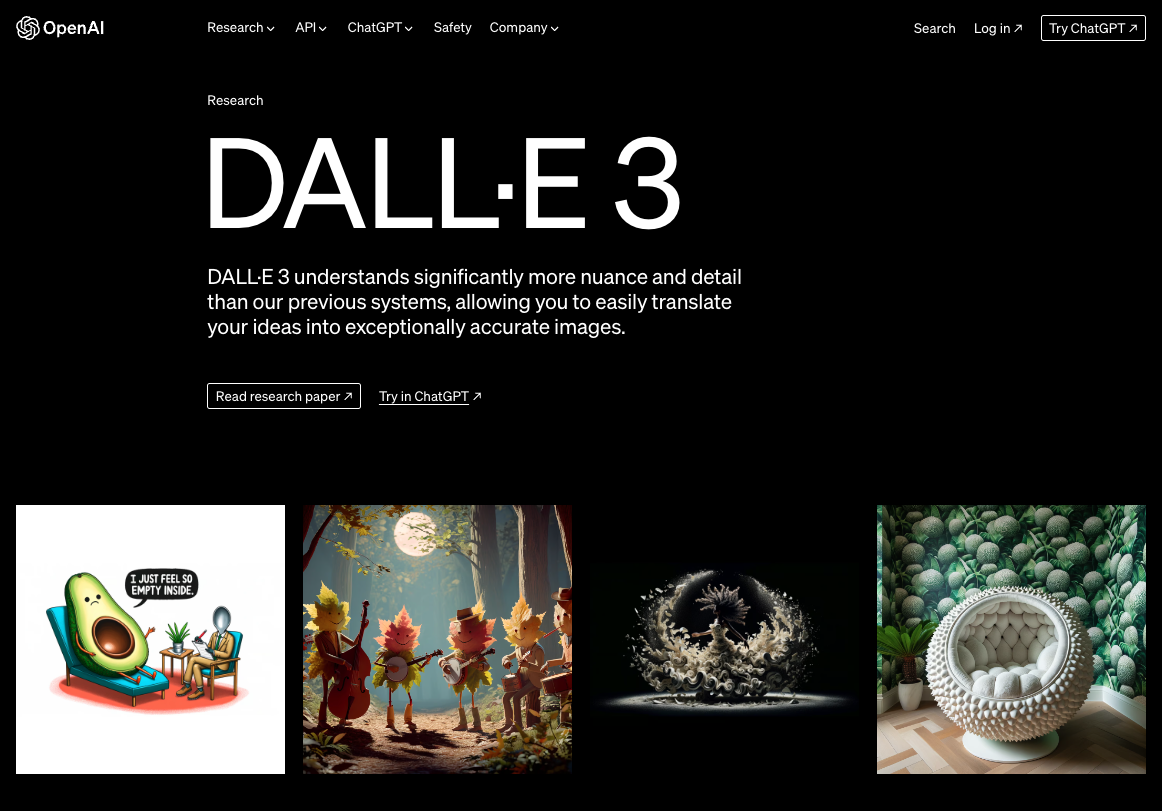

DALL-E 3

DALL-E 3 è un prodotto del laboratorio di ricerca di OpenAI ed è il generatore di immagini AI più noto a cui la gente pensa. Il suo predecessore una volta era chiuso con accesso limitato, ma oggi è possibile accedervi tramite Microsoft Copilot e ChatGPT Plus.

Per coloro che possono accedervi, alcuni dei risultati che può ottenere sono incredibili. Inizialmente è stato chiuso a causa delle preoccupazioni relative all’etica e alla sicurezza di tale strumento, sebbene si sia ampliato gradualmente nel tempo.

Uno dei maggiori vantaggi di DALL-E 3 è la capacità di creare immagini fotorealistiche che, a prima vista, sono indistinguibili dalle fotografie reali e possono incorporare testo, qualcosa con cui i modelli hanno storicamente lottato.

Può generare dipinti, immagini che sembrano essere state catturate da fotocamere vere e scenari interamente inventati. Ha rappresentato un enorme salto nelle capacità dell’intelligenza artificiale quando è stato annunciato per la prima volta, sia nella sua capacità di creare immagini che nell’elaborazione del linguaggio naturale, nota come PNL.

Questo grazie alla sua implementazione di GPT-4, che è uno dei modelli linguistici più avanzati disponibili ed è anch’esso creato da OpenAI. Proprio come con Stable Diffusion, DALL-E 3 ha anche la capacità di prendere immagini esistenti e modificarle in base a un prompt.

Puoi modificare le foto tramite esso chiedendogli di aggiungere qualcosa a un’immagine, o anche chiedergli di rimuovere qualcosa o di cambiare l’illuminazione. DALL-E 3 può essere provato da tutti, tramite la versione gratuita di Microsoft Copilot o tramite un abbonamento ChatGPT Plus a pagamento.

Midjourney

Midjourney è interessante in quanto è una piattaforma pubblica in grado di generare immagini, anche se lo fai tramite un server Discord. Anche se prima era gratuito, a causa dell’abuso della piattaforma ora anche il livello di utilizzo più basso viene pagato, a partire da 10 dollari al mese.

Si tratta di una barriera piuttosto alta in quando ci sono altre opzioni gratuite, come Stable Diffusion da usare in locale o l’utilizzo di Microsoft Copilot. Per darvi un’idea di quanto sia potente Midjourney, un utente del servizio, Jason Allen, ha creato un pezzo che ha soprannominato “Théâtre D’opéra Spatial”. Ha partecipato al concorso d’arte della Colorado State Fair… e ha vinto .

A differenza di questi altri progetti, Midjourney è un programma proprietario di intelligenza artificiale. Non esiste un codice sorgente che tu possa guardare e il suo intero scopo in questo momento è limitato all’utilizzo all’interno di un server Discord.

Tuttavia, da allora, la società ha lavorato all’aggiornamento e alla messa a punto di Midjourney. Midjourney Model Version 6 è l’ultima versione del modello, che si basa sui modelli Midjourney implementati per allontanarsi dall’aspetto “predefinito”. Al giorno d’oggi, Midjourney è significativamente migliore rispetto a allora, ma lo sono anche tutti questi modelli.

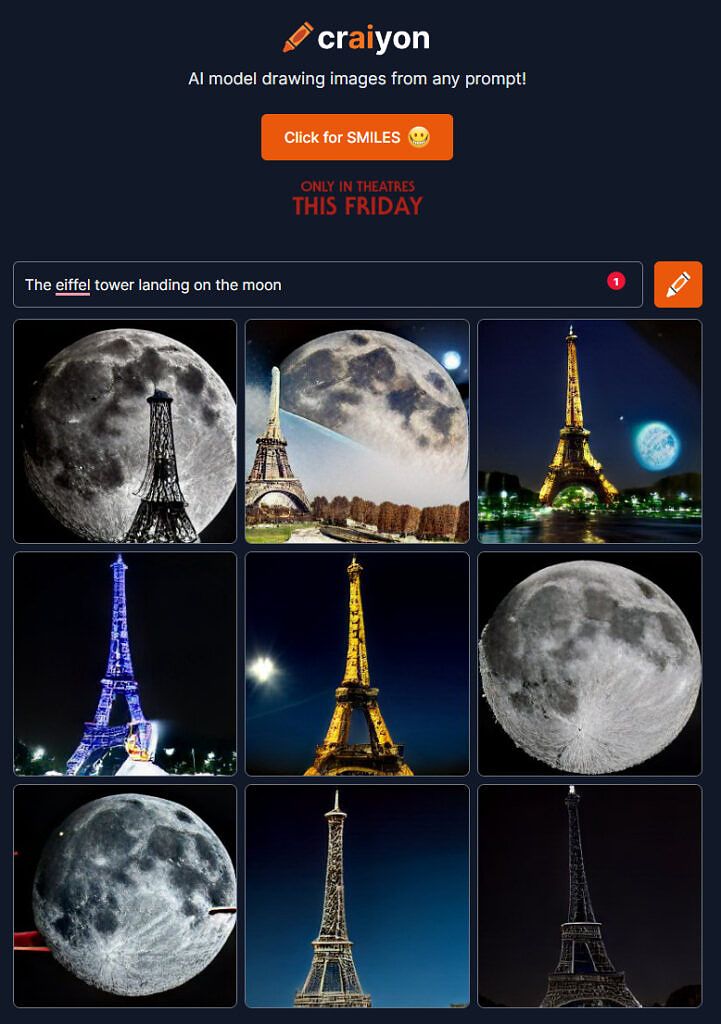

Crayon

Craiyon era precedentemente noto come DALL-E Mini, sebbene, nonostante il nome, non abbia alcuna relazione con DALL-E 2. È stato creato per riprodurre i risultati partendo dal modello testo-immagine DALL-E di OpenAI.

Craiyon è disponibile al pubblico e può essere utilizzato per generare immagini sorprendentemente decenti, sebbene le immagini non siano altrettanto accurate, né di alta qualità. Le risoluzioni delle immagini raggiungono il massimo a 256×256 e non ci sono nemmeno strumenti di upscaling.

Craiyon è completamente gratuito e accessibile tramite il suo sito web. Puoi generare qualsiasi immagine tramite qualsiasi prompt e l’unico problema è che le immagini sono di qualità inferiore e dovrai attendere circa due minuti per ogni batch di immagini generate.

Craiyon è iniziato come modello open source volto a riprodurre i risultati del modello DALL·E iniziale. Il modello attualmente utilizzato è noto come DALL·E Mega e presenta numerosi miglioramenti ma non è ancora disponibile ufficialmente.

Craiyon, a differenza delle altre opzioni, è supportato dalle entrate pubblicitarie. Di conseguenza, durante la visita vedrai sponsorizzazioni a pagamento e altri annunci pubblicitari sul loro sito web. Esiste anche un’app per smartphone Android. Non è il più sofisticato, ma è divertente, facile da usare e accessibile.

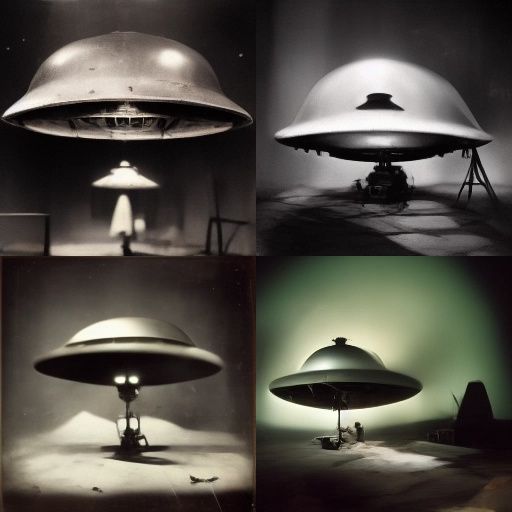

I pericoli e l’etica dell’arte generata dall’intelligenza artificiale

L’arte generata dall’intelligenza artificiale, sebbene interessante, impone una serie di pericoli alla società in generale. In un’epoca in cui può essere difficile dirlo quando le notizie vengono estrapolate dal contesto o semplicemente inventate, c’è il pericolo quando è possibile realizzare in pochi minuti immagini che sembrano reali.

Sebbene l’immagine generata sia falsa, sembra che potrebbe essere reale e diffusa in maniera non lecita. Eventuali artefatti possono essere spiegati in modo molto buono, tanto da condire l’immagine falsa con altrettante parole false.

Il punto in cui diventa ancora più oscuro è che puoi effettivamente specificare un artista da cui vuoi che l’algoritmo tragga ispirazione. Un artista comune è Greg Rutkowski, che si è espresso apertamente contro l’uso del suo nome nell’arte generata dall’intelligenza artificiale.

Il suo nome è uno dei suggerimenti più comuni utilizzati nella generazione di immagini. “L’intelligenza artificiale dovrebbe escludere gli artisti viventi dal suo database”, ha detto Rutkowski ad Artnet in un’intervista, “concentrandosi sulle opere di pubblico dominio”.

La ricerca del nome di Rutkowski restituirà spesso immagini di intelligenza artificiale che sono state generate per assomigliare al suo lavoro ma che in realtà non sono sue. Ancora peggio è che l’arte generata dall’intelligenza artificiale può spesso evidenziare i pregiudizi della razza umana.

Craiyon ha anche un avvertimento in fondo alla sua home page nelle FAQ, in cui si afferma che “poiché il modello è stato addestrato su dati non filtrati provenienti da Internet, potrebbe generare immagini che contengono stereotipi dannosi“.

Di conseguenza, inserendo messaggi come “dirigente aziendale” verranno restituite molto spesso immagini di uomini bianchi in giacca e cravatta. Allo stesso modo, inserendo “insegnante” come prompt quasi sempre donne che vanno in classe.

Il futuro dell’arte generata dall’intelligenza artificiale

Dato che sembra che il settore non stia rallentando e la regolamentazione non stia davvero recuperando terreno, ci aspettiamo di vedere ulteriori progressi in queste aree. Il fatto che siamo passati dalle capacità di DALL-E 2 a Stable Diffusion a DALL-E 3, in grado di generare testo, in appena un anno, mostra quanto sia grande questo settore e quanto grande possa essere un settore potenzialmente pericoloso.

Le immagini che in precedenza avrebbero potuto essere affidate a un team di artisti ora possono essere generate in pochi secondi, con un singolo artista coinvolto nel processo a fini correttivi. Un risparmio però di una forza lavoro non indifferente.

Abbiamo già visto come Midjourney può aiutarti a vincere un concorso artistico, ad esempio, anche se il Copyright Office degli Stati Uniti attualmente afferma che non puoi nemmeno proteggere le immagini generate dall’intelligenza artificiale.

Anche le immagini costano denaro poiché vengono generate su server incredibilmente potenti, soprattutto quando un numero enorme di utenti arriva a generare le proprie immagini. Sarà estremamente proibitivo in termini di costi per tutti i nuovi produttori che entrano in questo mercato, il che potrebbe a sua volta scoraggiare anche alcune aziende.

Tuttavia, gli sforzi iniziali come Stable Diffusion come open source sono di buon auspicio e gli utenti possono eseguire modelli sui propri computer. Democratizzare la generazione di immagini in questo modo, come è successo con LLM e LM Studio, livella in qualche modo il campo di gioco.

Naturalmente, da allora, abbiamo visto anche il lancio di Sora, il modello text-to-video di OpenAI in grado di generare video di 60 secondi con un semplice script di testo. È spaventoso e ha un impatto significativamente maggiore rispetto alla generazione di immagini e, con il recente lancio di Stable Video Diffusion, probabilmente saremo in grado di generare video complessi e lungi in futuro.

Di conseguenza, aspetteremo con impazienza di vedere il futuro delle immagini AI. Il panorama si è evoluto così rapidamente nell’ultimo anno e sembra che ogni giorno vengono fuori nuovi progressi. Tuttavia, con gli la manipolazione delle immagini basata sull’intelligenza artificiale che arrivano anche sui nostri smartphone, potrebbero succedere molte cose nei prossimi uno o due anni.

INDICE DEI CONTENUTI

Lascia un commento

Visualizza commenti